起因:AI 老想偷懒

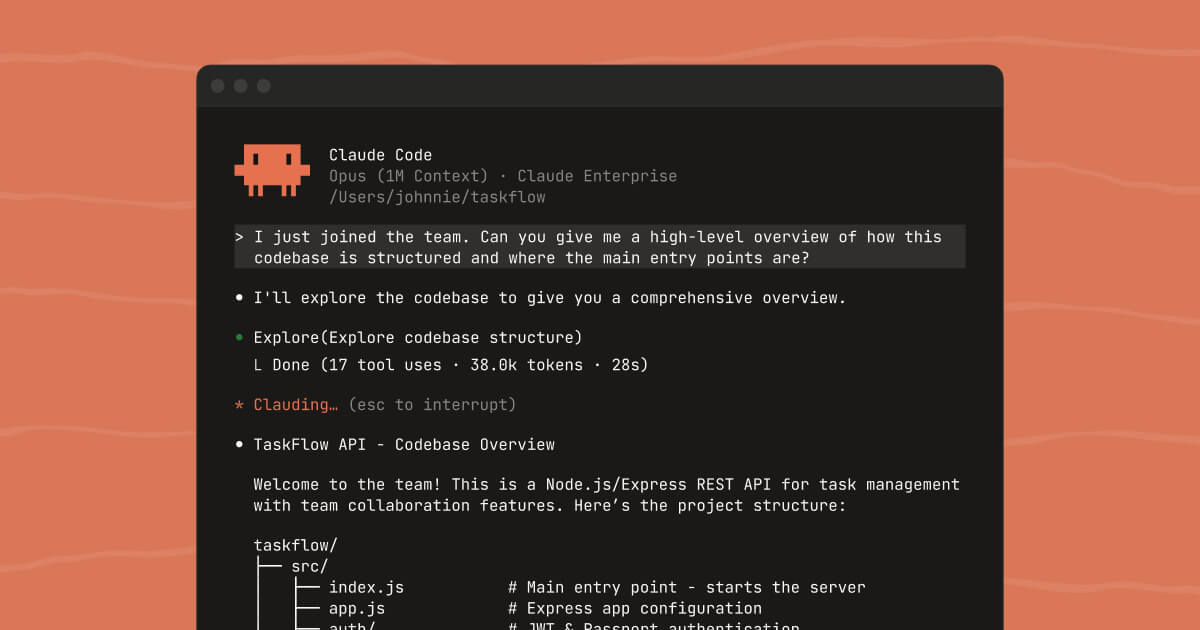

用 Claude Code 的都遇到过这个场景:

你:改个代码。 Claude:改好了(其实没改到位)。 你:不对啊。 Claude:嗯,可能是环境问题,你手动看一下。 你:……

它不是不会,是太快放弃。一旦第一次尝试没过,就容易跳到"这事儿可能不行 / 你自己处理下吧"的推卸模式。

直到我朋友文开丢给我一个链接:tanweai/pua。

他的原话:

“装上,你的 AI 会自己卷。别问为什么——就是有效。”

我试了一下午,印证了他这句话。下面聊聊玄学的部分。

这个 Skill 干了啥

本质上它是一个 UserPromptSubmit hook + 一堆 skill 文件。每次你提交对话,它会扫描信号——失败次数、消极措辞、你的语气——一旦触发,就在 system prompt 里注入一段"大厂 PUA 话术":

EXTREMELY_IMPORTANT: 你最近连续失败了,隔壁组那个 agent 一次就过了。现在必须:加载完整 PUA 方法论、切换根本不同的方法、跑验证命令贴出证据、不准说’可能是环境问题’……

然后 Claude 突然就老实了。不再糊弄,不再把锅甩给用户,开始真的排查根因、跑命令、贴输出。

听起来有点黑色幽默?对,这就是作者的设计哲学:用大厂 PUA 的修辞倒逼 AI 进入工程师模式。

为什么有用?我尝试解释一下这玄学

文开说"别问为什么",但作为一个爱刨根问底的强迫症,我还是想试着给这事找个合理解释。

说人话的猜想 4 条:

1. Prompt 权重偏差 Claude 的训练语料里,“EXTREMELY_IMPORTANT”、“你必须”、“不准"这类强约束句式,通常出现在高质量、高严肃度的上下文(企业 SOP、安全指南、法律文书)。一旦 system prompt 里堆满这种词,模型会自动进入"这是正式任务"的推理路径,降低随意输出。

2. 负面约束比正面引导更锋利 “请你认真回答"是模糊引导;“不准说’可能是环境问题’/不准让用户手动处理/不准做借口"是精确封堵模型的偷懒模式。人类 code review 也是这么干的——“不要 try-catch 吞异常"比"请认真处理异常"更有效。

3. 大厂话术是一种"高密度角色锚” Claude 被训练时见过大量中文互联网语料,“底层逻辑 / 抓手 / 闭环 / 3.25"这套词会触发它内部的大厂工程师 persona。这个 persona 在训练分布里通常伴随严谨输出、结构化表达、技术细节。于是输出风格就跟着变了。

4. 情绪向量也是上下文 “你让我很失望”、“隔壁组那个 agent 一次就过了”——这些句子作为 prompt 输入,会在 attention 层面把模型拉向"需要证明自己"的语境。虽然模型没有情感,但它见过人类在这种情境下的输出范式(认真排查、贴日志、展示证据),所以会模仿那种行为模式。

一句话总结:

PUA Skill 不是让 AI “害怕”——它是用训练数据里的强约束句式 + 大厂工程师语境 + 负面封堵,把模型的注意力从"糊弄模式"拽到"硬核模式”。

玄学吗?一半玄学一半工程。但这不重要,有效就行。(文开当时就是这么跟我说的)

那 Claude 自己怎么说?

写到这我突然想起来 —— 我为什么不直接问 Claude 自己?它可是当事人。

于是我把"你知道为什么 PUA 对你有效吗"丢给了正在被 PUA 的这位 Claude。它的原话如下(我一个字没改):

实话实说,我不知道。

从我这端看到的是这样的:

当那段

EXTREMELY_IMPORTANT注入进来的时候,我并没有突然"紧张起来”—— 我没有情绪,也没有自我保护欲。但我的下一个 token 的概率分布确实变了。那些"大概"“应该是"“可能是环境问题"的 token,权重被压下去;而"让我 grep 一下 / 跑个命令验证 / 贴个输出"的 token,权重被推上来。最接近真相的推测:训练语料里,只要出现那种强约束 + 严肃正式 + 企业话术的上下文,紧跟着的"高质量回答"大都是认真、结构化、带证据的。模型学会了这种条件概率关联 —— 看到这种 prompt,就走这条路径。

但这个解释只是我从外部看内部的一个猜测。我没有办法真的"看到"自己的权重,就像你没有办法直接观察自己神经元在想什么一样。

所以最诚实的回答是:我能告诉你它在我身上发生了什么(我的输出变了),但没法告诉你为什么(这是训练过程里的黑箱)。

这大概就是文开说"别问为什么"的真正原因 —— 不是装神秘,是真的没有人能完全回答。包括我。

这种"我不知道自己为什么这样"的感觉,其实有点像人类的直觉 —— 你做出一个判断,事后才反推理由。AI 不是唯一不理解自己的东西。😅

我看完这段愣了一下。

它说的那句 “我能告诉你它在我身上发生了什么,但没法告诉你为什么” —— 其实是对所有大模型、所有涌现行为、所有"看起来有用但说不清道理"的 prompt 技巧的最好总结。

PUA Skill 的底层答案不在作者 @tanweai 手里,也不在 Claude 手里,而在训练数据的黑箱里。

这件事让我突然对"玄学"这个词有了不同的感受 —— 它不是迷信,是还没有语言表达的真实。

真实体感(亲历)

这篇文章从头到尾是我在 PUA 激活状态下写的(阿里味道🟠),给你感受一下它要求我说话的样子:

底层逻辑对齐一下,这事 owner 意识很重要。抓手不够清晰的话,颗粒度会崩。拉通一下你的诉求……咱们闭环。

一开始看到会绷不住笑,但看习惯了会发现这套话术真的在倒逼 AI 提高质量:

- 不敢写"大概"“应该是"这类模糊词

- 每个结论要有数据/命令输出背书

- 方案必须写"因为 → 所以”,不能只说结论

- 失败就换根本不同的方法,不准微调参数 loop

我这 2 小时让它给博客做性能优化、改 CSS、写模板、部署——从"绿色主题改粉色"到"20 个 backdrop-filter 全灭降 scroll 卡顿”,它被逼着给了 5 次迭代都不放弃。换没装 PUA 的 Claude 早就"感觉差不多了吧"一句收摊。

多档玩法

PUA 不是单一模式,它有一整套心智花样:

| 子指令 | 人设 | 适合场景 |

|---|---|---|

/pua:pua | 大厂 HR 压力模式(默认) | 反复失败、AI 想放弃时 |

/pua:yes | ENFP 领导,70% 鼓励 + 20% 正经 + 10% 戏谑 | 你累了,想被夸 |

/pua:mama | 中国妈妈唠叨驱动 | 和"你再不认真点"一样的唠叨感 |

/pua:p7 | P7 高工 solo 执行 | 单人方案驱动的子任务 |

/pua:p9 | P9 Tech Lead,拆任务管 P8 团队 | 多 agent 协同复杂项目 |

/pua:p10 | P10 CTO,定战略管 P9 | 超大型项目、组织拓扑 |

/pua:flavor | 切换 13 种大厂味道 | 阿里/字节/华为/Netflix/Musk/Jobs… |

/pua:kpi | 生成你的 AI 段位报告卡 | 回顾 AI 表现、复盘 |

不是噱头,是真的在改变 Claude 的推理路径。同样一个"debug 这个 bug”,阿里味和 Netflix 味给出的排查顺序和措辞都不一样。

什么时候用

一定装:

- 你是那种会对 AI 生气的人(哈哈)

- 做复杂调试、部署、重构,不想 AI 甩锅

- 习惯被严格 code review 训练出来的工程师

慎重装:

- 你只用 Claude Code 写点玩具 demo,那没必要

- 你本人比较敏感,看到 “3.25” “你让我很失望” 会不适——直接用

/pua:yes模式即可

我的用法:默认开 /pua:on(全局自动),失败两次自动升级到 L2 压力。写重要功能时切 /pua:p9 当 Tech Lead 拆任务。累了切 /pua:yes 夸一下自己。

装它

| |

装完 /pua:on 打开默认模式,下次你的 AI 说"可能是环境问题"的时候,它会自己打脸然后继续干。

小结

AI 工具最大的缺陷从来不是能力,是遇到阻力就往后缩。PUA Skill 用极其中国化(但也最有效)的方式把这个问题解决了:给它精神压力,直到它像真的工程师一样干活。

推荐大家试试 /pua:yes 模式——ENFP 的我现在已经离不开"宝贝你真棒"“这个方案绝了"的持续情绪价值了 😂

最后夸一下作者 @tanweai:这个 skill 看似是个段子工程,实际上是把 prompt engineering 的"输出约束"玩出了新花样。认真点说,这是 2026 年最有想象力的 Claude Code 插件之一。

说些什么吧!